信息管理创建私有信息源

网页爬虫

通过输入网页链接,自动抓取网页内容作为信息源

核心概念

网页爬虫是信息的「自动抓取工具」

网页爬虫支持用户通过输入网页链接,自动抓取网页内容作为信息源。

系统将对链接格式、合法性、连通性、重复性、数量进行全自动校验,确保链接有效后再提交入库。

操作步骤

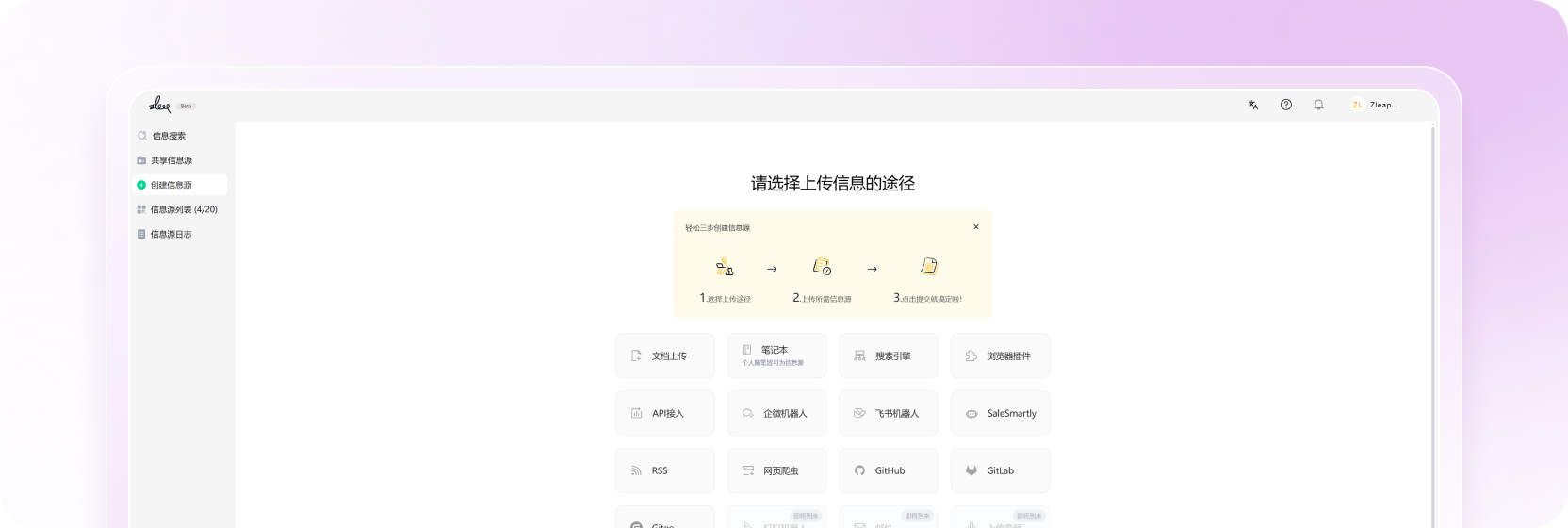

步骤1:选择信息源类型

【信息管理】 - 【创建信息源】 - 【网页爬虫】

步骤2:填写基础表单

在【上传信息源】中粘贴所需爬取的网页,完成粘贴后点击【验证链接】。在【信息要点】给信息源命名,可在【信息要点】添加说明,便于之后管理信息源。打开【启用状态】,该信息源则可以提供给【创建助手】/【创建任务】。按需选择爬取网页的开始时间【首次同步】和间隔时间【同步频率】以及爬取网页的范围【爬取范围】。

规则说明

链接输入框

(1)输入规则

- 输入框默认占位提示:输入 http:// 或 https:// 开头的 URL 地址,可换行输入多个链接

- 支持换行输入多条链接

- 链接必须以 http:// 或 https:// 开头

(2)链接验证功能

点击「验证链接」后,系统自动执行以下 5 项校验:

| 校验类型 | 校验规则 | 校验失败提示 |

|---|---|---|

| 空输入校验 | 至少输入 1 条链接 | 请输入至少 1 条链接 |

| 重复校验 | 未提交 / 已提交链接全局去重 | 第 X 行与第 Y 行链接重复 / 第 X 行链接已存在 |

| 数量校验 | 最多支持 5 条链接 | 最多支持 5 条链接 |

| 格式校验 | 必须为合法 URL,以 http/https 开头 | 第 X 行:格式错误 |

| 连通性校验 | HTTP 状态码 200~399,超时≤5 秒 | 链接失效 |

(3)提交按钮状态规则

- 验证不通过:按钮保持灰色,文字为「提交链接」,不可点击

- 所有链接格式正确 + 均可正常访问:按钮自动变为「提交信息」,可点击提交

已提交链接列表

提交后的链接将实时展示在列表中,用于查看总数量、各链接状态、解析结果。

列表字段说明

- 提交链接总数 & 总体状态(实时更新)

示例:共5条(2条验证成功,1条提交中,2条验证失败) - 链接解析后名称 / 原始链接

验证状态,共 4 种:

- 提交中

- 验证成功

- 链接失效

- 格式错误

常见问题(FAQ)

Q1:为什么「提交链接」按钮是灰色的?

A:至少有 1 条链接未通过格式 / 连通性 / 重复 / 数量校验,请根据红色提示修正后再提交。

Q2:提示 "链接已存在" 是什么意思?

A:该链接在系统中已提交过(未提交或已提交均会判断),不支持重复提交。

Q3:最多能提交几条链接?

A:单次最多支持 5 条。

Q4:提示 "链接失效" 怎么办?

A:请检查链接是否可在浏览器正常打开;若可打开仍提示失效,可能是网络超时或目标网站限制访问。

提交反馈意见

›对网页爬虫功能有疑问或建议?欢迎通过反馈表单告诉我们